Akamai Firewall for AI: Holen Sie sich leistungsstarken Schutz für neue LLM-Anwendungs-Bedrohungen

Weltweit setzen Unternehmen auf künstliche Intelligenz (KI), um ihr Geschäft durch höhere Produktivität, verbesserte Prozesse und niedrigere Kosten zu optimieren. Eine der am häufigsten verwendeten Formen der KI sind große Sprachmodelle (Large Language Models, LLMs), die Unternehmen einsetzen, um unter anderem Kundenanfragen zu beantworten und passgenaue Informationen bereitzustellen.

KI-Modelle und LLMs sind anfällig für Angriffe

Neben den Vorteilen von LLMs ergeben sich jedoch neue Risiken und Bedrohungen. KI-Systeme enthalten wertvolles internes Wissen und sensible Datensätze. Somit sind sie ein Hauptziel für Angreifer. LLMs sind anfällig für neue und spezifische Angriffsarten, wie:

Prompt-Injection-Angriffe – Angreifer manipulieren von der KI generierte Antworten, um sensible Daten zu leaken oder Sicherheitsmaßnahmen zu umgehen.

KI-spezifische DoS-Angriffe (Denial-of-Service) – Angreifer überfluten KI-Modelle mit einer Vielzahl von Abfragen, um Ressourcen zu überlasten.

Toxische Ausgaben und Halluzinationen – KI-Modelle erzeugen irreführende, voreingenommene oder beleidigende Inhalte, die den Unternehmensruf schädigen können.

Datenextraktion und Modelldiebstahl – Angreifer versuchen, proprietäres Wissen aus KI-Modellen zu extrahieren.

Anforderungen in Bezug auf Compliance und Governance – Branchenrichtlinien wie die OWASP Top 10 für LLMs erfordern eine stärkere Kontrolle.

Cybersicherheitsteams müssen ihre Unternehmen schützen, ohne dass dadurch die Innovationen und Produktivitätsverbesserungen von LLMs eingeschränkt werden. Und sie dürfen auch nicht das Kundenerlebnis beeinträchtigen. Doch herkömmliche Sicherheitsmaßnahmen sind nicht darauf ausgelegt, vor den neuen Bedrohungen zu schützen. Es werden Schutzmechanismen benötigt, die speziell entwickelt wurden, um LLM-Angriffe zu erkennen und abzuwehren.

Schützen Sie die Integrität, Sicherheit und Zuverlässigkeit von KI-Anwendungen

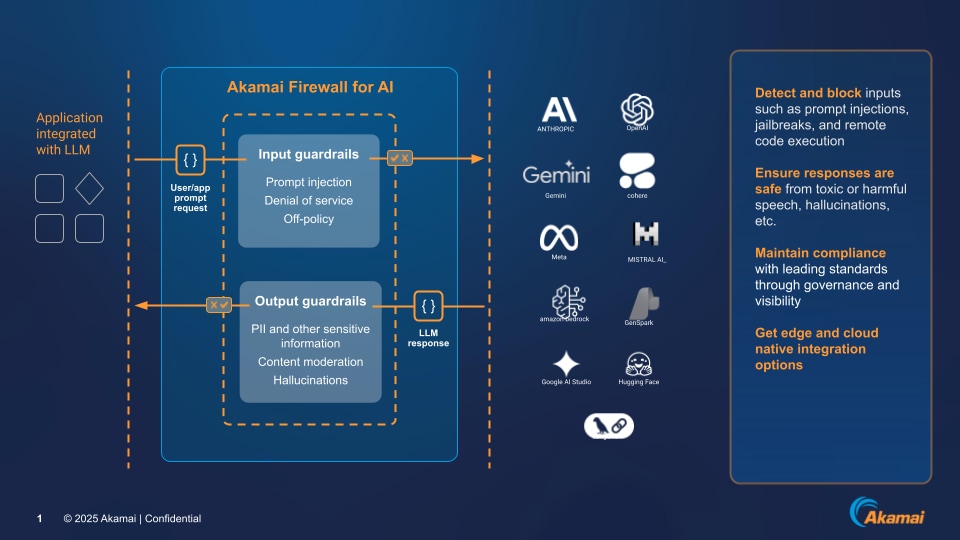

Mit Akamai Firewall for AI stellen wir heute eine speziell entwickelte Sicherheitslösung vor, die KI-basierte Anwendungen, LLMs und KI-basierte APIs vor aufkommenden Cyberbedrohungen schützt. Firewall for AI sichert sowohl eingehende KI-Abfragen als auch ausgehende KI-Antworten und schließt dadurch kritische Sicherheitslücken, die durch generative KI entstehen.

Dank Bedrohungserkennung in Echtzeit, richtlinienbasierter Durchsetzung und adaptiven Sicherheitsmaßnahmen schützt die Firewall vor Prompt-Injections, Abfluss sensibler Daten, ausnutzbaren Schwachstellen und KI-spezifischen DoS-Angriffen. Dadurch werden die Integrität, Sicherheit und Zuverlässigkeit von Ki-basierten Innovationen geschützt.

Spezielle Funktionen

Zu den speziellen Funktionen von Firewall for AI gehören Folgende:

- Mehrschichtiger Schutz: Missbräuchliche Eingaben, nicht autorisierte Abfragen und groß angelegte Datenscraping-Versuche werden blockiert, um Systemmanipulation und Datenextraktion zu verhindern.

KI-Bedrohungserkennung in Echtzeit: Es werden adaptive Sicherheitsregeln angewandt, um dynamisch auf sich weiterentwickelnde KI-basierte Angriffe zu reagieren, einschließlich Prompt Injection und Systemausnutzung.

Compliance und Datenschutz: Dadurch wird gewährleistet, dass KI-generierter Output sicher bleibt und mit gesetzlichen und branchenspezifischen Standards in Einklang steht.

Flexible Bereitstellungsoptionen: Bereitstellung über Akamai Edge, REST API oder Reverse Proxy für eine nahtlose Integration in vorhandene Sicherheitsframeworks.

- Proaktive Abwehr von Risiken: Um toxische Inhalte, Halluzinationen und unbefugte Datenlecks zu vermeiden, wird der KI-Output gefiltert.

So funktioniert es

Firewall for AI überprüft Ein- und Ausgaben und stellt sicher, dass Ihre Sicherheitsvorkehrungen intakt bleiben, indem schädliche Eingabeaufforderungen erkannt und blockiert und nur sichere, zuverlässige Antworten bereitgestellt werden (Abbildung).

Firewall for AI überprüft beispielsweise die LLM-Prompts auf Manipulationsversuche, wie z. B. Formulierungen, die dazu dienen, die Datenschutz- und Sicherheitsvorkehrungen des LLM zu umgehen. In ähnlicher Weise werden die Antworten des LLM untersucht, bevor diese die Nutzer erreichen. Dies trägt dazu bei, die Offenlegung sensibler Daten wie Kundenkontonummern zu verhindern.

KI wird in zunehmendem Maß zum Bestandteil Ihrer zentralen Geschäftsanwendungen und diese Inspektionsstufe lässt sich problemlos in Ihren Anwendungstestprozess integrieren, um so Vertrauen und die Zuverlässigkeit auf jeder Stufe zu stärken.

Mehr erfahren

Erfahren Sie mehr darüber, wie Akamai Firewall for AI LLMs schützen kann, ohne Ihr Unternehmen zu auszubremsen.