IA na cibersegurança: como a IA está impactando a luta contra o crime cibernético

Índice

O cenário em mudança da cibersegurança com IA

A inteligência artificial (IA) está transformando rapidamente quase todos os setores, e a cibersegurança não é exceção. A IA tem um impacto duplo neste campo: Por um lado, cibercriminosos estão usando IA para conduzir ataques cibernéticos mais sofisticados e direcionados; por outro, a IA está impulsionando avanços significativos nas defesas de cibersegurança, permitindo que equipes de segurança identifiquem e respondam a ataques com mais velocidade e precisão do que nunca.

Nesta publicação do blog, exploraremos essa transformação na cibersegurança, analisando as maneiras pelas quais especialistas em cibersegurança estão usando IA para responder a ataques mais sofisticados e direcionados.

Combater a batalha contínua das vulnerabilidades digitais com a cibersegurança de IA

As vulnerabilidades cibernéticas aumentaram significativamente nos últimos anos, e a rápida evolução da inteligência artificial está desempenhando um papel fundamental nesse crescimento exponencial. A IA permite que cibercriminosos e hackers explorem vulnerabilidades de forma mais eficaz, evitem a detecção, executem ataques mais sofisticados e ampliem suas operações.

A ascensão dos ciberataques com IA: como hackers usam IA para violar a segurança

A Figura 1 mostra as principais formas pelas quais a IA pode amplificar os ciberataques, incluindo:

Ataques de phishing com tecnologia de IA

Malware e ransomware alimentados por aprendizado de máquina

IA em engenharia social

Ataques de phishing com tecnologia de IA

Um ataque de phishing é um tipo de ataque cibernético no qual um cibercriminoso engana uma pessoa para que revele informações confidenciais, fingindo ser uma fonte confiável.

Técnicas baseadas em IA, como deepfakes e falsificações avançadas com tecnologia de IA, tornaram os ataques de phishing mais realistas e pessoais e cada vez mais difíceis de detectar. Por exemplo, chamadas telefônicas em que o autor da ligação se passa por outra pessoa acontecem há décadas. No entanto, com IA, o invasor pode incluir informações pessoais de alguém próximo ao alvo.

Em ataques de phishing com IA, cibercriminosos usam vários modelos de aprendizado de IA, como análise comportamental, clonagem de voz e modelos de processamento de linguagem natural (NLP), para criar impressões cibernéticas hiper-realistas geradas por IA. Usando essas tecnologias, os invasores podem imitar de forma convincente a aparência, voz ou até estilos de escrita e fala de amigos e colegas, tornando mais fácil enganar suas vítimas e aumentar suas taxas de sucesso.

Deepfakes são a mais recente ferramenta em phishing impulsionado por IA

Uma aplicação cada vez mais comum da IA no cibercrime é o uso do aprendizado de máquina para criar deepfakes de mídia, como vídeos, imagens e áudio que parecem autênticos, mas são totalmente fabricados. O aumento da tecnologia deepfake no cibercrime é uma ameaça crescente, e as consequências de ser vítima de um golpe de phishing deepfake podem ser devastadoras.

No início de 2024, um funcionário em Hong Kong participou de uma videochamada com golpistas que usaram representações deepfake de seus colegas de trabalho para convencê-lo a transferir US$ 25 milhões em fundos da empresa para os golpistas.

Operadores de bots usando IA para se adaptar mais rapidamente após serem detectados

O gerenciamento de bots sempre foi um jogo de gato e rato: empresas de segurança criam melhores detecções; operadores de bots aprendem a evadir essas detecções; as empresas de segurança criam novas detecções; e o padrão continua se repetindo.

A IA permite que os operadores de bots conduzam o comportamento de maneiras mais sofisticadas para reduzir o tempo necessário para evitar novas detecções, usar metodologias de ataque mais adaptáveis e replicar mais fielmente o envolvimento humano. Indicadores de um operador de bot aproveitando IA incluem:

Evolução rápida de táticas: os métodos de ataque mudam rapidamente em resposta à detecção.

Maior variação no comportamento: os bots baseados em IA podem usar técnicas como o fuzzing automatizado para explorar permutações e tentar burlar as defesas.

Mimetismo de interação semelhante à humana: envolve imitação avançada do comportamento real do usuário, incluindo padrões aleatórios de cliques, teclas digitadas ou movimentos do mouse.

Malware e ransomware alimentados por aprendizado de máquina

As ciberameaças com tecnologia de IA assumem muitas formas. Nos últimos anos, a rápida evolução de malware com IA permitiu que hackers desenvolvessem malware mais evasivo e adaptável, o que aumenta significativamente a eficácia de ataques de malware e ransomware.

O ransomware, um tipo de malware que criptografa os dados da vítima e exige um resgate por sua liberação, tornou-se mais formidável com a integração da IA. Os criminosos virtuais agora podem usar IA em ataques de ransomware para evitar detecção e executar ataques mais rápidos e complexos.

O malware adaptativo potencializado por IA permite que hackers contornem medidas de segurança de forma mais eficaz. Ao analisar o tráfego de rede, esse tipo de malware com aprendizado de máquina aprende a imitar o comportamento legítimo do usuário e pode alterar suas ações, estilo de comunicação e código para evitar a detecção por sistemas de segurança tradicionais.

Além disso, algoritmos de aprendizado de máquina permitem que invasores identifiquem com mais precisão vulnerabilidades em sistemas de segurança, visem os dados mais valiosos e adaptem métodos de criptografia às características específicas de um sistema, dificultando a descriptografia das informações roubadas. Alguns atacantes de ransomware também usam IA para automatizar certas tarefas, como criptografia, a fim de acelerar ataques e deixar as vítimas com menos tempo para responder.

IA em engenharia social

Em ataques de engenharia social, invasores dependem de manipulação psicológica e engano para obter informações confidenciais ou ativos de suas vítimas. Ao usar IA em engenharia social, os invasores podem criar golpes mais personalizados, que são mais difíceis de serem identificados pelos indivíduos.

A análise de IA permite que cibercriminosos inventem golpes de engenharia social altamente personalizados. Ao incluir em e-mails de phishing e outras comunicações detalhes pessoais, eventos recentes e gatilhos emocionais obtidos a partir do rastro digital do alvo, os invasores podem criar comunicações que parecem extremamente genuínas e conseguem ganhar a confiança mais facilmente.

Os invasores também estão usando cada vez mais a IA conversacional em cibercrimes para ampliar seus esforços, tornando ameaças cibernéticas como golpes com chatbots alimentados por IA ainda mais comuns. Os modelos de chatbot com IA agora podem imitar conversas humanas com precisão impressionante, criando argumentos persuasivos e aprendendo a explorar sinais emocionais. Ao recorrer a chatbots com IA para realizar ciberataques, os invasores podem automatizar as interações e liberar seu tempo para visar um número maior de vítimas, sem precisar se envolver em conversas diretas.

O papel da IA na detecção de ameaças e na segurança

Embora seja verdade que a IA tenha o potencial de ampliar as ciberameaças, seu potencial para melhorar a cibersegurança é igualmente significativo. Ao aplicar o poder do aprendizado de máquina, tecnologias de caça a ameaças baseadas em IA podem ajudar organizações a detectar e responder a ameaças com mais precisão e velocidade do que medidas tradicionais.

Alguns casos de uso da IA para melhorar os sistemas de segurança incluem:

Melhoria na detecção de ameaças com IA

As ferramentas de cibersegurança impulsionadas por IA, baseadas em algoritmos de aprendizado de máquina, podem analisar grandes volumes de dados em tempo real, aprender padrões e identificar anomalias que possam indicar ameaças potenciais. A velocidade dessa análise permite que profissionais de cibersegurança detectem incidentes de segurança de forma mais rápida e precisa do que nunca.

Ferramentas avançadas de IA com aprendizado de máquina também podem ajudar profissionais de segurança a identificar ameaças notoriamente difíceis de detectar, como o movimento lateral. Movimento lateral é a tática que invasores usam para navegar por uma rede sem serem detectados, identificando alvos de alto valor e expandindo seu acesso.

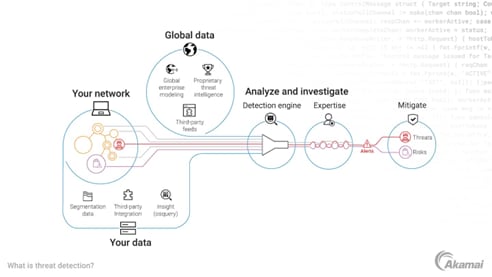

Por exemplo, a Akamai usa GNNs (graph neural networks, redes neurais gráficas) para detectar movimento lateral potencial dentro de uma rede. As GNNs primeiro aprendem as interações típicas entre os ativos de uma rede e depois usam esse conhecimento para prever interações futuras. Se o comportamento de um ativo desviar significativamente do padrão estabelecido, ele é sinalizado como um possível indicador de movimento lateral.

A Figura 2 ilustra como a Akamai usa IA em seus serviços de cibersegurança Akamai Guardicore Segmentation e Akamai Hunt.

Priorização de ameaças e automatização de respostas

Outro papel fundamental da IA no aprimoramento das operações de segurança é permitir respostas automatizadas a incidentes, melhorando significativamente os tempos de resposta em comparação com a intervenção manual humana. Ao acelerar a resposta a ameaças, a resposta automatizada a incidentes com IA ajuda organizações a mitigar danos potenciais antes que um problema possa escalar.

Funciona da seguinte forma: Uma vez que uma ameaça é detectada, sistemas baseados em IA executam automaticamente ações predefinidas para neutralizar o risco, como isolar um ativo afetado ou bloquear tráfego malicioso de entrar em uma rede. Além disso, algoritmos de IA com aprendizado de máquina avaliam e determinam a gravidade das ameaças e priorizam respostas com base na urgência.

Devido à sua incrível velocidade e capacidade de lidar com várias ameaças simultaneamente, sistemas de IA oferecem às organizações uma abordagem mais eficiente e eficaz para gestão de riscos, permitindo lidar com novas ameaças em tempo real, em escala.

Aprimoramento da inteligência preditiva de ameaças

Os profissionais de cibersegurança podem usar inteligência artificial para prever e prevenir ameaças potenciais com base em tendências históricas, o que pode aumentar a precisão de suas capacidades de detecção de ameaças.

Os modelos de IA com aprendizado de máquina analisam grandes conjuntos de dados de uma variedade de fontes. Por meio dessa análise de informações de relatórios de incidentes anteriores, registros de segurança, padrões de tráfego de rede e mais, as equipes de cibersegurança podem começar a identificar tendências e padrões, aprimorando sua compreensão de ciberameaças comuns.

Os sistemas de IA podem então usar essas tendências para prever quando e como futuras ameaças ocorrerão e configurar automações como medida preventiva antes mesmo de a ameaça se materializar.

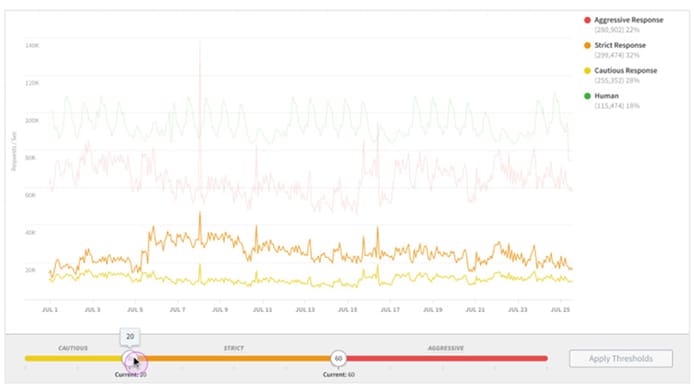

Por exemplo, o Akamai Bot Manager usa uma estrutura de IA para monitorar tráfego de bots e detectar ameaças na borda da rede, em escala e em tempo real (Figura 3).

Compreensão de limitações: quando a IA pode não ser a resposta

Embora a IA ofereça poderosos aprimoramentos para a cibersegurança, é importante lembrar suas limitações.

Os sistemas de IA aprendem apenas com os dados que recebem, e não têm a capacidade humana de considerar o contexto mais amplo. Por causa disso, sistemas de IA podem ter dificuldades em tomar decisões em situações complexas e sutis. Se um sistema de IA for treinado com informações incompletas ou enviesadas, refletirá esse mesmo viés ou falta de contexto em sua tomada de decisão.

Essa falta de nuance também pode fazer com que sistemas de IA ocasionalmente sinalizem tráfego legítimo como potenciais ameaças, gerando falsos positivos. Os falsos positivos podem impedir que usuários legítimos concluam transações e fazer com que as organizações percam negócios e diminuam a satisfação do cliente.

Por fim, como a IA depende de grandes quantidades de dados para aprender, a privacidade e a segurança desses dados estão em risco. Sem medidas de segurança adequadas, empresas correm o risco de que invasores obtenham acesso não autorizado a grandes volumes de dados confidenciais, caso ocorra uma violação.

O uso de IA só tende a crescer em todos os setores. Em uma pesquisa recente da McKinsey sobre o estado da IA, 71% dos entrevistados relataram que suas organizações estão usando regularmente IA generativa em pelo menos uma função de negócios, um aumento em relação aos 65% do ano passado e um salto significativo em relação aos apenas 33% em 2023.

À medida que os sistemas de IA se tornam mais avançados, espera-se que desempenhem um papel ainda maior na defesa cibernética nos próximos anos. A IA provavelmente trará novos avanços na detecção e mitigação de ameaças, permitindo que equipes de cibersegurança ampliem continuamente seus esforços e reajam a ameaças mais rapidamente.

Adoção da IA para um mundo digital mais seguro

A IA desempenha cada vez mais um papel crucial em ciberataques e cibersegurança. Para responder a um cenário de ameaças em constante expansão e altamente sofisticado, a Akamai está na vanguarda da implementação estratégica e transparente de IA para fortalecer a segurança.

As ferramentas de cibersegurança da Akamai potencializadas por IA executam uma variedade de tarefas críticas. Soluções inovadoras com IA, como o Akamai Hunt, estão permitindo que organizações detectem e respondam a ameaças mais rápido e com mais precisão do que nunca. A plataforma Akamai Guardicore combina IA de edge com a experiência da Akamai para ajudar os clientes a alcançar o Zero Trust, reduzir o risco de ransomware e atender aos requisitos de conformidade.

Aumente a postura de segurança da sua organização com soluções de cibersegurança que utilizam a IA de forma responsável e eficaz.